はじめに:手軽さの代償か?LM Studioでの挑戦

前回はllama.cppでのビルド(7258)に成功しましたが、「もっと手軽にGUIでチャットしたい!」ということで、今回はLM StudioでBonsai 8Bを動かしてみました。

結論から言うと、「動く。しかし、忍耐が必要。」。そんな検証結果をシェアします。

1. LM Studioでの導入ステップ

LM Studioを使えば、モデルの検索からダウンロード、チャット実行までがマウス操作だけで完結します。

手順①:LM Studioのインストール

まだ導入していない方は、公式サイトからWindows版をダウンロードしてインストールしてください。

手順②:Bonsai 8Bの検索とダウンロード

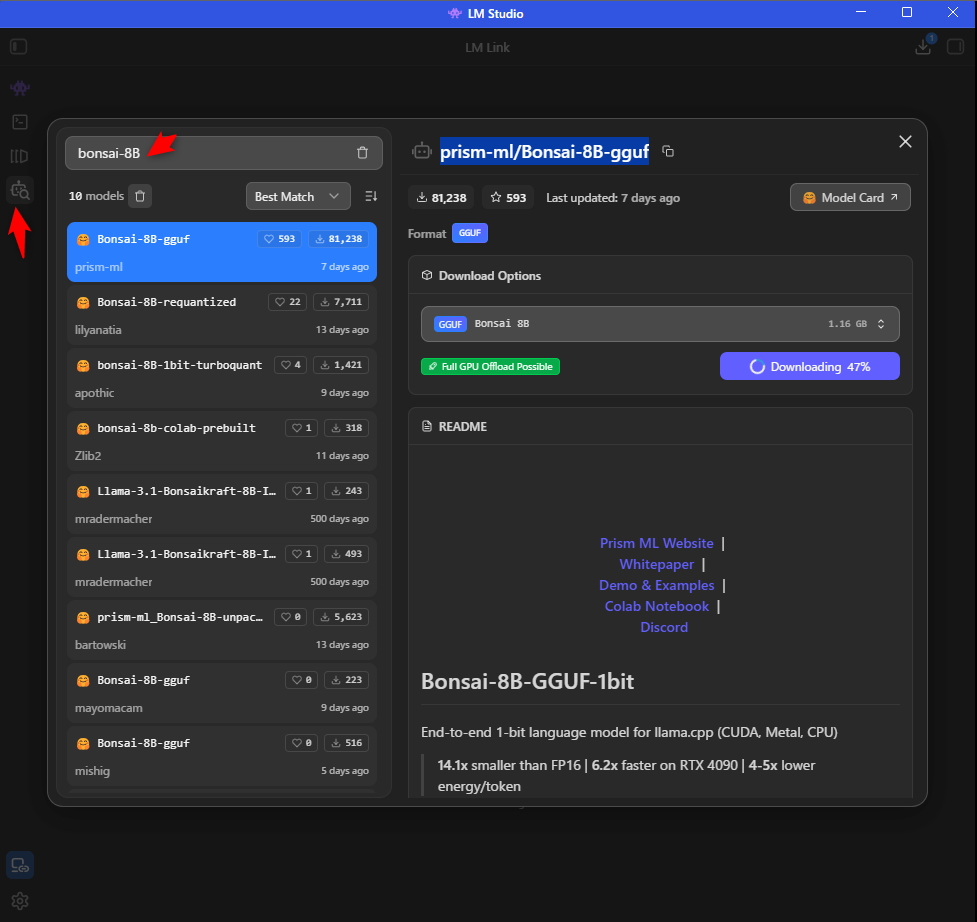

- LM Studioを起動し、左側の虫眼鏡アイコンをクリックします。

- 検索窓に 「Bonsai-8B」 と入力します。

- リストの中から 「prism-ml/Bonsai-8B-gguf」 を選択します。

- 右側のパネルから、自分の環境に合った量子化サイズを選んで「Download」をクリックします。

手順③:チャットの開始

- 左側の吹き出しアイコン(AI Chat)をクリックします。

- 画面上部の「Select a model to load」から、ダウンロードしたBonsai 8Bを選択します。

- ロードが完了すれば、すぐに会話を始められます。

2. Intel N100での動作状況レポート

さて、ここからが本題です。低電力・省スペースで人気の Intel N100 ミニPCで、このBonsai 8Bがどう動くのか。実際に検証した結果がこちらです。

動作ステータス

ロード時間:約1分

N100環境では、モデルの読み込みに約1分ほどかかりました。 モデルサイズが1.15GBと軽量なため、これまでの8Bモデルに比べればかなり速い印象です。

メモリ消費:余裕あり

ここが1ビットLLMの真骨頂。起動後もシステムメモリにはかなりの余裕があります。 「メモリ不足でPCが固まる」という、ローカルLLM特有の恐怖はありません。

レスポンス速度

準備万端、いざ「こんにちは」と入力してみると……。

- CPU負荷: 100%に完全ロック。

- 応答時間: いつまでかかるか分からないレベル。

「こんにちは」という簡単な挨拶を返すだけで、文字通り「日が暮れるのではないか」と思うほどの沈黙が流れます。

なぜN100×LM Studioでは「沈黙」が続くのか?(技術的考察)

前回のllama.cpp(CLI版)ではある程度の速度で動いていたのに、なぜLM Studioではここまで遅いのでしょうか。組み込みエンジニア視点で考察してみました。

① 1ビット専用カーネルの不在

前回の記事では、PrismML公式の1ビットモデル専用に最適化されたllama.cppを自分でビルドしました。しかし、LM Studioが内部で使用している推論エンジンは汎用的なものです。 1ビットモデル特有の計算を「無理やり汎用的な処理」で動かしているため、効率が極端に落ちている可能性があります。

② AVX2命令セットの限界

Bonsai 8BのようなBitNet(1-bit LLM)は、特定のハードウェア命令(AVX-512など)があれば爆速ですが、N100がサポートするのはAVX2まで。 1ビットの重みを計算用に展開する「アンパッキング」の処理が、N100の非力なEコアには荷が重すぎるようです。

まとめ:N100×Bonsai 8Bの現在地

今回の検証で分かったのは、まだ、最適化ができていないだけなのかもしれませんが、やはり「1ビットLLMでも、低電力CPUでGUIを介した推論はまだ時期尚早」ということ。

メモリはクリアしましたが、次は「演算能力」の壁。N100の限界を知ることで、逆に「エッジAIにおけるハードウェアの重要性」を再認識する結果となりましたが、これもまた、ローカルLLM検証の醍醐味(?)ですね。

コメント